Qu'est-ce que le Model Context Protocol (MCP) ?

Le Model Context Protocol est un protocole open-source développé par Anthropic, fin 2024, qui permet aux IA génératives - Claude, ChatGPT, Gemini... - de se connecter à des sources de données et des outils externes de façon sécurisée et interopérable.

Imaginez que chaque outil de votre organisation - CRM, base de données, outils internes, fichiers partagés - puisse être interrogé directement par votre assistant IA, sans développement sur-mesure, sans connecteur propriétaire à maintenir. C'est précisément ce que le Model Context Protocol (MCP) rend possible.

Quel-est le problème que le MCP résout ?

Les grands modèles de langage (LLMs) ont une limite majeure : ils ne savent que ce qu'on leur dit au moment de la requête. Pour qu'un assistant IA puisse répondre à une question sur les données d'un CRM, les tickets d'un outil de gestion de projet, ou les fichiers d'un drive partagé, il faut lui injecter ces données - en temps réel, de façon contrôlée, et sécurisée.

Avant le MCP, chaque équipe développait son propre connecteur. Un connecteur pour Slack, un pour GitHub, un pour Notion, un pour Salesforce. Chacun avec sa logique, son authentification, sa gestion des erreurs. Le résultat : une fragmentation technique coûteuse à maintenir, et une prolifération de connecteurs propriétaires incompatibles entre eux.

C'est ce problème que le MCP adresse avec une approche radicalement simple : standardiser la façon dont les LLMs se connectent aux sources de données externes, quelle que soit la source, quel que soit le modèle.

L'analogie qui circule dans la communauté IA est parlante : le MCP est au connecteur IA ce que l'USB-C est aux câbles. Un standard universel qui met fin à la multiplication des adaptateurs.

Les trois composantes du MCP

1. L'hôte

L'hôte est l'application IA qui orchestre les interactions. Claude Desktop en est l'exemple canonique. C'est le point d'entrée de l'utilisateur : il pose une question, l'hôte détermine quelles ressources externes sont nécessaires pour y répondre, et déclenche les appels appropriés.

2. Le client

Le client est le composant technique, intégré à l'hôte, qui gère la communication avec les serveurs MCP. Il traduit les besoins du LLM en requêtes standardisées, et restitue les réponses dans le format attendu par le modèle. C'est la couche qui rend le protocole transparent pour l'utilisateur final.

3. Le serveur

Le serveur MCP est le composant qui expose les données et les outils. Il peut être développé en TypeScript ou Python (les deux langages officiellement supportés), et implémente les trois primitives fondamentales du protocole.

Comment fonctionne le MCP ?

Voici comment se déroule une interaction typique via MCP :

- L'utilisateur pose une question à son assistant IA : "Quels sont les tickets Jira ouverts depuis plus de 7 jours dans notre sprint en cours ?"

- L'hôte (Claude Desktop, par exemple) identifie qu'une Resource ou un Tool Jira est disponible via MCP.

- Le client formule une requête standardisée vers le serveur MCP Jira.

- Le serveur interroge l'API Jira, filtre les résultats, et retourne les données.

- Le LLM synthétise la réponse à partir des données reçues et présente une réponse enrichie à l'utilisateur.

L'ensemble de ce flux se produit de façon transparente. L'utilisateur n'a pas besoin de savoir que plusieurs systèmes ont été interrogés en parallèle. Il obtient une réponse directe, ancrée dans des données réelles et fraîches.

Pourquoi le MCP est stratégique pour les marques ?

1. Fin de la dette technique des connecteurs

Avant le MCP, chaque intégration IA était une dette technique. Maintenir dix connecteurs custom pour dix sources de données différentes, avec les mises à jour d'API, les gestions d'authentification, les changements de modèles — c'était un travail considérable. Le MCP réduit cette dette drastiquement : une intégration correctement construite est compatible avec N modèles IA simultanément.

2. Données fraîches, hallucinations réduites

Les LLMs hallucinent principalement quand ils n'ont pas les données pour répondre correctement. En injectant des données fraîches via MCP au moment de la requête, on réduit mécaniquement le risque de réponse inexacte. Le modèle répond à partir de faits récents, pas de sa mémoire d'entraînement.

3. Sécurité et conformité maîtrisées

Le MCP intègre nativement les bonnes pratiques de sécurité : modèle de permissions granulaires, isolation des accès, audit des appels. Pour les marques opérant sous contrainte RGPD ou soumises à des exigences de conformité, c'est un avantage structurel par rapport aux intégrations ad hoc.

4. Interopérabilité multi-modèles

L'un des enjeux stratégiques des années à venir est de ne pas être verrouillé sur un seul fournisseur de LLM. Une architecture MCP-first permet de changer de modèle sans refactoriser l'ensemble des intégrations. C'est la même logique que la philosophie API-first appliquée à l'IA.

L'approche MCP-first en agence : le cas Origine

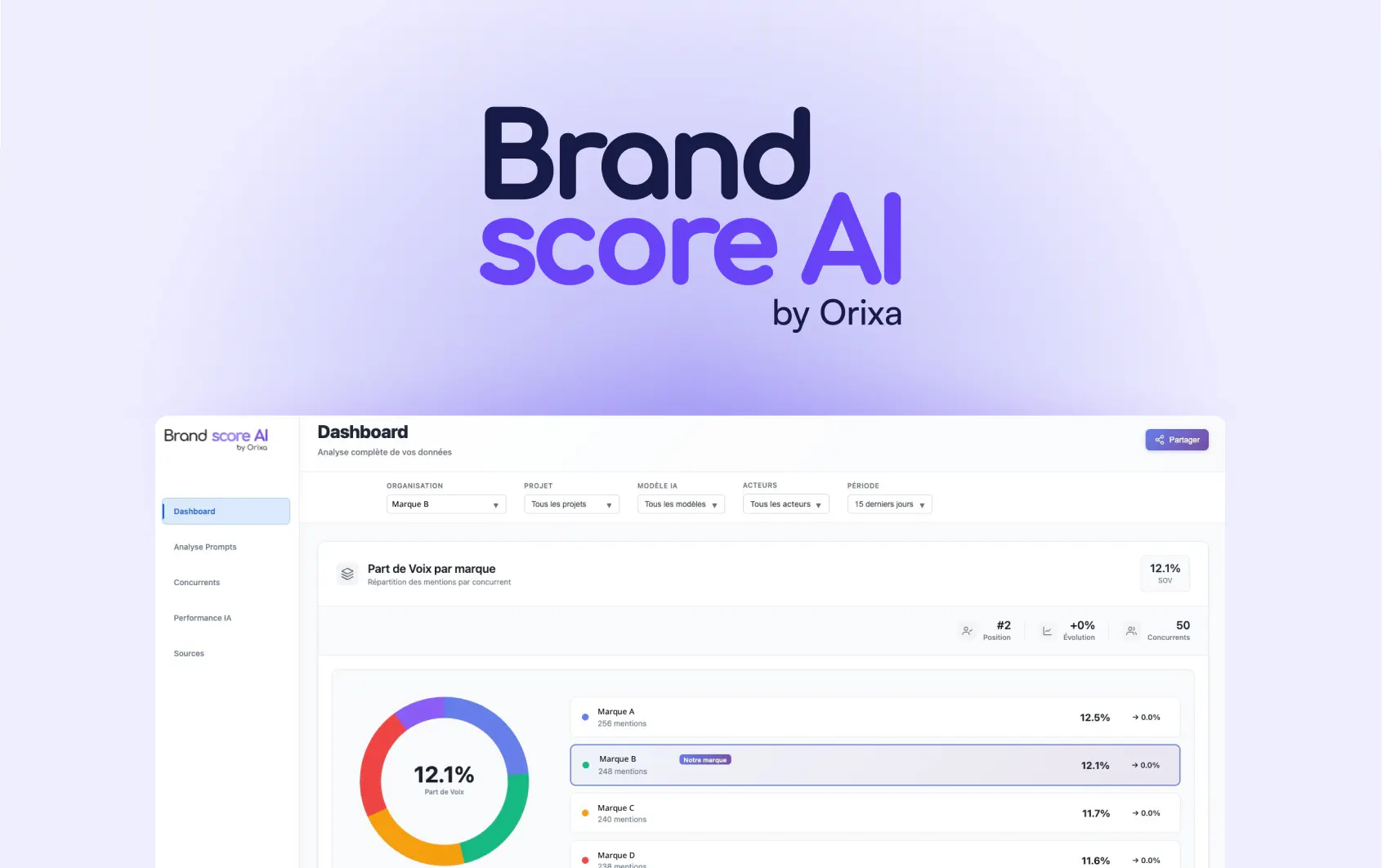

Chez Origine, nous avons fait le choix d'une architecture MCP-first pour tous les outils internes que nous développons. L'objectif est concret : permettre à nos consultants - qu'ils travaillent sur des stratégies SEO, GEO ou data - de brancher directement leurs assistants IA sur les technologies propriétaires de l'agence, sans interface intermédiaire, sans friction.

Nos équipes peuvent ainsi interroger des technologies comme Brand Score AI, accéder aux données de monitoring GEO en temps réel, et exploiter nos bases de données métier directement depuis leurs assistants IA. C'est un gain de productivité concret : zéro copier-coller de données entre interfaces, zéro délai d'accès, zéro friction opérationnelle.